行政の進化と革新のための生成AIの調達・利活用に係るガイドライン

います。生成AIの可能性に期待が集まる一方、その安全性・信頼性を確保するルール作りも加速しています。

2023年のG7広島サミットでは生成AIを含む高度なAIシステムの国際的なガバナンス枠組み「広島AIプロセス」が立ち上げられ、同年12月には包括的な政策枠組みと国際指針が合意されました。日本政府もデジタル社会の実現に向けた重点計画(2024年6月閣議決定)で生成AIのリスク低減と利活用推進を掲げ、経済産業省・総務省はAI事業者ガイドライン(2024年4月公表)でAI提供側の統一指針を示すなど、官民双方でガバナンス体制の整備を進めてきました。

こうした状況を踏まえ、政府は行政への生成AI活用を促進しつつリスク管理も一体で進めるためのガイドラインの策定を進めてきました。今回はデジタル庁が2025年5月27日に発表したその『行政の進化と革新のための生成AIの調達・利活用に係るガイドライン』の内容をもとに、行政における本ガイドライン策定の背景や概要、活用方針や今後の展望などについて、取り上げたいと思います。

ガイドライン策定の背景

政府が生成AIガイドラインを策定した背景には、国際的なAIガバナンスの潮流と国内政策上の必要性があります。G7広島プロセスでは生成AIが経済社会に及ぼす影響の大きさから、各国が緊急に対応すべき課題と位置付けられ、信頼できるAI普及のための包括的枠組み作りが進められました。この国際指針を受けて各国は具体的な法規制や指針整備に乗り出しており、日本でも各分野に点在していたAIガイドラインの統合策定が進行中です。

国内では、デジタル社会推進計画において生成AIを含むAIの利活用推進とリスク対策が重点課題に挙げられ、2023年には生成AI実証事業を通じて官民での取り組みも進められました。また経産省・総務省による「AI事業者ガイドライン」(第1.0版)が示されたことで、AI開発・提供企業が順守すべき統一的な原則が整備され、今回の行政向けガイドラインもそれと整合する形で策定されています。

ガイドラインの目的と適用範囲

本ガイドラインの目的は、生成AIのもたらすメリットを行政改革に取り入れながら、そのリスクを適切に管理するための政府統一ルールを定めることにあります。従来、各府省庁が個別にAI活用を検討していましたが、政府全体で「使わないことによる機会損失」と「使い方を誤るリスク」の両面に対応する統一指針が求められていました。本ガイドラインはデジタル庁が経産省や総務省などと協力して検討したもので、生成AI利活用促進とリスク対策を表裏一体で進める政府の公式見解と位置付けられています。

適用範囲としては、国の行政機関が調達・運用する情報システムのうち、生成AI(大規模言語モデルを用いたテキスト生成AI)を構成要素とするものが対象です。本ガイドラインが想定する生成AIとは文章の自動生成機能であり、画像や動画を生成するAI、AIエージェントのような高度なAIについては今後の国内外動向や行政での活用状況に応じて検討対象となります。

一方で、防衛・安全保障や公共の秩序維持に関わる機微情報、特定秘密や重要な経済安保情報、秘文書に該当する情報を扱うシステムは適用除外とされました。また独立行政法人や法人格の特殊法人での生成AI活用についても本ガイドラインに準拠した対応が期待されており、地方公共団体にも必要に応じ参考とすることが望まれています。

適用対象者は中央省庁の職員(システムの企画者やサービス提供責任者)とし、政府職員が調達手続や契約を通じてベンダーに本ガイドライン順守を求め、連携して取組を進めることとされています。ガイドラインの適用スケジュールは、令和8年度(2026年度)以降に調達・運用する生成AIシステムから全面適用としつつ、令和7年度中(2025年度)の導入案件についても可能な限り準拠した取組が推奨されています。今年度は移行期間として各府省庁がガイドラインに沿った運用体制を整え、来年度以降に本格適用するロードマップが示されています。

政府の利活用方針と推進体制

政府全体の利活用方針として、本ガイドラインは「生成AIの積極活用」と「リスク管理の徹底」を両立することを明確に掲げています。新技術を安易に避けるのではなく、リスクに蓋をせず適切に対処しながらイノベーションを促進する前向きな姿勢です。具体的には、各府省庁が業務への生成AI導入を検討する際に統一的なチェックシートでリスク評価を行い、高リスクと判断しても必要な対策を講じた上で活用を進めることを推奨しています。このような「使いながら鍛える」方針の下、生成AIを行政の進化・革新につなげていくことが狙いです。

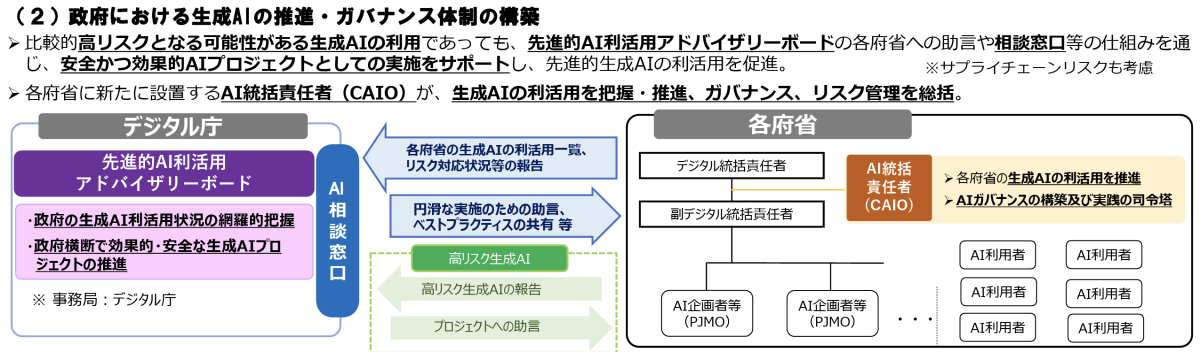

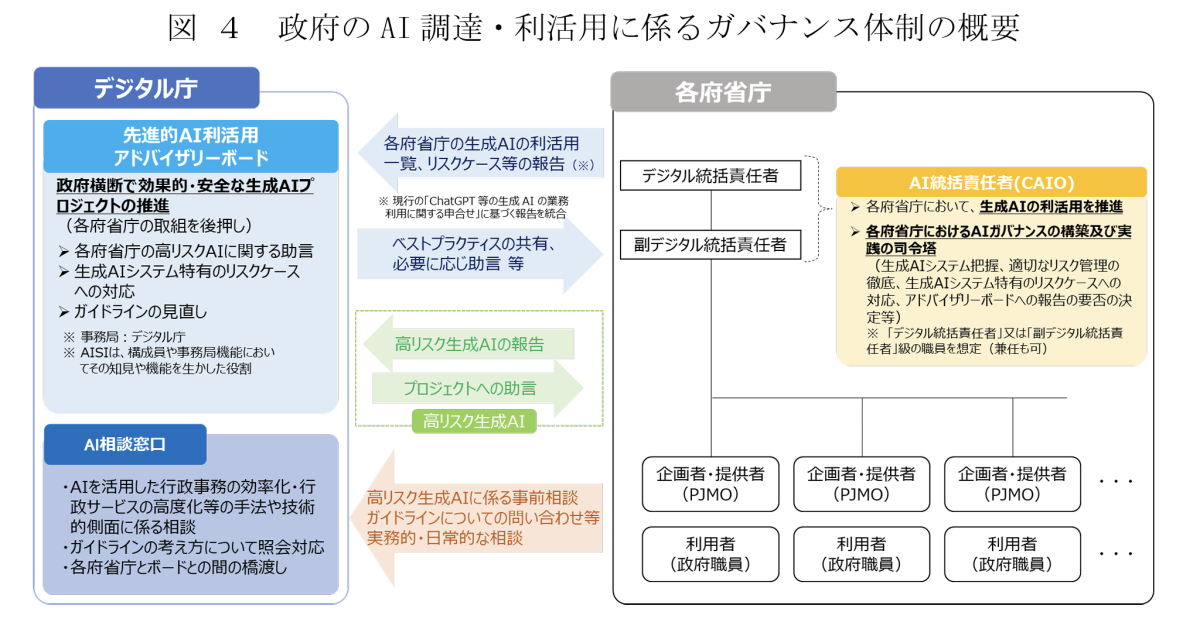

推進体制の面では、新たなガバナンス枠組みが整備されました。まず各府省庁にはAI統括責任者(CAIO: Chief AI Officer)を設置し、当該府省における生成AI導入計画の立案からデータ取扱い、調達・契約、運用管理まで一元的に把握・統率する役割を担わせます。CAIOは各府省のデジタル統括責任者(CIO)級の幹部が兼任する想定で、組織内のAI活用を牽引するとともにAIガバナンス構築と実践の司令塔となります。具体的には府省内の生成AIシステムの状況把握、適切なリスク管理の徹底、リテラシー向上研修の推進、高リスク案件の有無判断など幅広い責務を負います。

さらにデジタル庁においては、有識者で構成される先進的AI利活用アドバイザリーボードを設置し、政府横断の支援体制を整えました。このボードにはAI安全性研究機関(AISI)などの専門家も参画し、その知見を行政AI活用の監督・助言に生かします。ボードの役割は各府省の生成AI導入状況を俯瞰し、高リスクになり得る案件の評価とリスク軽減策の助言、優良事例(ベストプラクティス)の収集・発信、発生したリスク事案の共有と再発防止策の提言など多岐にわたります。

各府省のCAIOは自省内の生成AI活用状況を四半期ごとにボードへ報告することとされ、必要に応じデジタル庁の「AI相談窓口」を通じた助言・支援も受けられる仕組みです。このように省庁内と政府全体の両面で推進役と支援役を配置することで、現場での利活用促進と統制・支援を両立する体制が構築されています。

生成AIの便益と具体例

ガイドラインでは生成AIを行政に取り入れることで得られる便益(メリット)についても整理されています。代表的なものは業務効率化、企画立案力の向上、情報分析力の向上の3分野です。

業務効率化では、文章作成支援や要約といった用途が挙げられます。例えば職員が挨拶文やメール文を一から作成する代わりに、生成AIに指定内容の下書きを作らせて細部を調整すれば、短時間で体裁の整った文書を作成できます。また、議事録や報告書など長文テキストの要点要約も瞬時に可能となり、煩雑な文書から短時間で本質を把握することができます。翻訳もその一例で、日本語文書を英語にAI翻訳し、逆翻訳で精度確認することで大幅な時間短縮が可能です。これらは職員の定型業務を効率化し、本来注力すべき企画業務などに時間を振り向ける効果が期待されます。

企画立案力の向上では、ブレインストーミング支援が挙げられます。生成AIにアイデア出しをさせ、それをたたき台に職員が内容を深掘りすることで、より短時間で質の高い企画書を作成できます。AIが提示した複数の企画案から新たな着想を得たり考えを整理するうちに、従来にない発想で政策立案が進む可能性もあります。AIが"第二の頭脳"として下調べや素案作成を補助し、人間が最終判断・創意工夫を加えることで、より洗練された企画立案プロセスが実現します。

情報収集・分析力の向上では、大量の文書データから必要情報を抽出・整理する用途が考えられます。各府省庁の過去事例や蓄積された行政文書を生成AIに調査させれば、人手では膨大な時間を要するリサーチも瞬時に行えます。例えば類似の行政施策の事例検索や、世論の傾向分析などに生成AIを用いることで、政策立案に必要な知見を短時間で得ることが可能になります。

以上のような便益は生成AI技術の急速な進歩とともに今後さらに拡大が期待されており、行政サービスの質向上や職員の生産性向上につながると考えられます。政府としてもこうしたメリットを正しく理解し、積極的に業務への活用を進めていく必要があるとガイドラインは指摘しています。

想定されるリスクとその対策

一方、生成AIの活用には無視できないリスクも存在します。ガイドラインでは利活用推進と並んでリスクの洗い出しと管理手法が示されており、特に「高リスクな生成AI利活用」についての考え方が詳述されています。

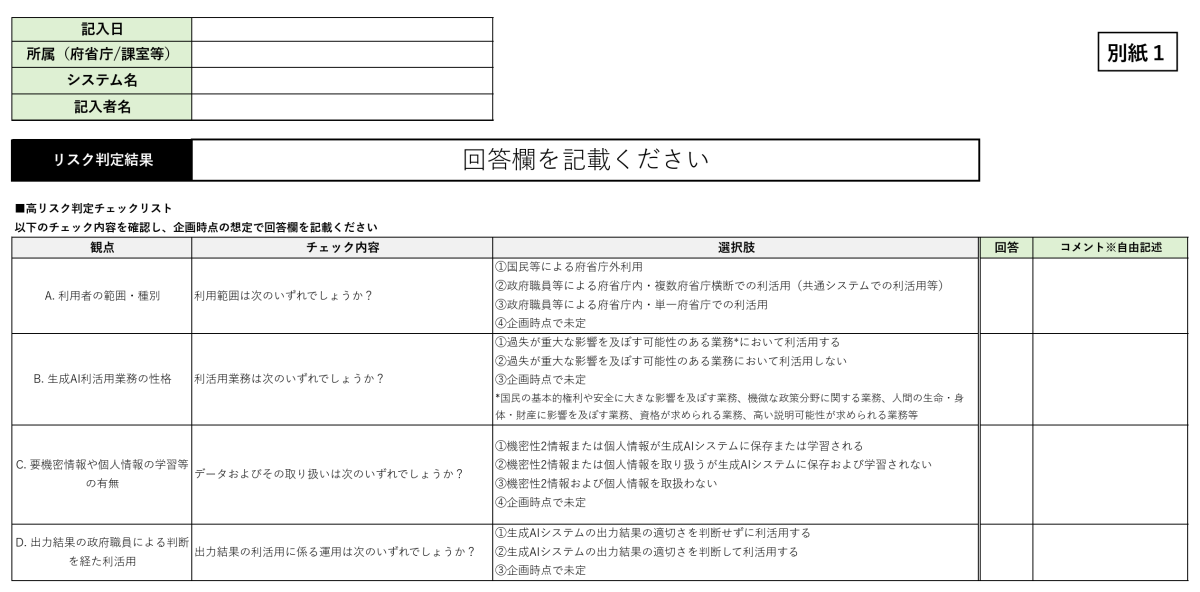

リスク評価に当たっては、一つの観点だけでなく複数のリスク軸を組み合わせて総合的に判断するアプローチが採られています。主なリスク軸にはA: 利用者の範囲・種別、B: 業務への影響の性質、C: データの機微度、D: 人の判断関与などが含まれます。

例えば「誰がどこで使うか」という軸では、内部の職員のみが使う場合に比べ、不特定多数の国民が利用するサービス形態の方がリスクも影響範囲も大きくなります。

「何に使うか」の軸では、AIの誤作動等により人命や権利に重大な影響を及ぼし得る業務か否かが重視されます。実際、府省庁外に提供する生成AIサービスで誤動作が起これば国民の安全に影響しかねないため、高リスクに該当する可能性が高い典型例とされています。

「どんなデータを扱うか」も重要で、学習データやプロンプト入力に機密情報や個人情報を含む場合は情報漏洩や不適切学習の懸念が高まりリスクが増大します。最後に「人のチェックを経るか」という軸では、生成AIの出力を職員が検証せず自動的に業務に反映する設計は誤情報拡散などの危険を伴うためリスクが高いと考えられます。

以上の観点を網羅した「高リスク判定シート」を用いて各府省のCAIOと担当者が事前評価を行い、高リスクの可能性が高いと判断した場合には必ずアドバイザリーボードへの報告・審議を経るフローになっています。逆に高リスクに当たらない場合でも、必要に応じデジタル庁に相談して専門的見解を得られる柔軟な運用が認められています。

高リスク判定シート(案)

具体的なリスク対策としては、まず法律やガイドラインで定められた遵守事項の徹底が挙げられます。個人情報保護やサイバーセキュリティ、著作権遵守など既存の法規制に適合する形でAIを利用することが大前提です。さらにガイドラインでは、AI事業者ガイドラインとも整合的にデータやアルゴリズムの公平性・透明性確保を求めています。

例えば事前学習や調整に用いるデータセットについて、人種・性別・年齢などによる偏りがないよう対策を講じること、偏りの有無を検証できる資料を用意することなど、AIモデルのバイアス低減策が明示されています。出力結果に関しても、ハルシネーション(もっともらしい誤情報)対策として必ず人間が内容の正確性・適切性を判断するプロセスを設けることが推奨されています。

万一不適切な生成結果が出た場合に備え、記録の保存や検証体制を整え再発防止に役立てることも重要です。また、サービス提供時には利用者に対してAI利用であることの明示や注意喚起を行い、誤解や過信を防ぐ措置も求められています。

総じてガイドラインのリスク対策は「事前のチェック体制強化」と「運用上の人間の介在・監督」に重点が置かれており、高リスクをゼロにできなくとも適切にリスクを低減しながら生成AIを利活用していくという実践的な姿勢が貫かれています。

今後の展望

ガイドライン策定を経て、行政における生成AI活用は実装フェーズへと移行します。令和7年度内は各府省庁で試行的にガイドラインに基づく取り組みを進め、運用上の課題や改善点を洗い出す期間となります。そして令和8年度以降の本格適用に向けて、得られた知見を共有し合いガイドライン自体もアップデートされていく見込みです。

アドバイザリーボードにはガイドラインの定期的な見直しを行う役割が明記されており、運用状況や最新の技術動向を踏まえて柔軟に改訂する姿勢が示されています。デジタル庁は各府省のCAIOを集めた連絡会も開催し、ボードでの議論内容や各府省の取り組み状況を共有・水平展開する予定です。

官民連携の観点では、政府が自ら生成AI活用の先進事例を創出することで、民間企業や地方自治体への波及効果も期待されます。各府省は行政改革につながるユースケースの発掘や、生成AIシステムの機能・品質・費用対効果の向上に努め、必要に応じてアドバイザリーボードや相談窓口の支援機能を活用することとされています。政府自らがロールモデルとなり、成功事例と教訓を積み重ねていく方針です。

民間AI事業者にとっても、政府が示すリスク管理基準を満たすことが事実上の信頼の証明となり、自社サービスの品質向上や競争力強化につながるでしょう。

生成AIを安全かつ効果的に使いこなす行政システムの確立は、行政DX(デジタルトランスフォーメーション)の推進のみならず、国全体の競争力向上にも直結します。政府は今後、広島AIプロセスでの国際合意も踏まえつつ、生成AIの調達と利活用による行政DXを進化させ、自国の経験をグローバルなAIガバナンス議論へ発信し、ロールモデルを形成していくことが期待されるところです。

![]()