広島AIプロセスに関するG7首脳声明と今後の展開

2023年10月30日、「広島AIプロセスに関するG7首脳声明」を公表しました。

また、政府は2023年11月7日、「AI戦略会議 第6回」を開催し、広島AIプロセスの検討状況と今後の進め方などについても、議論・検討を進めています。

広島AIプロセスに関するG7首脳声明

G7首脳声明の全文は以下のとおりです。

我々G7首脳は、高度な人工知能(AI)システム、特に、基盤モデル及び生成AIがもたらす革新的な機会と変革の可能性を強調する。我々はまた、リスクを管理し、人間を中心に据えつつ、個人、社会、並びに法の支配や民主主義の価値を含む我々の共有された原則を守る必要性を認識する。我々は、これらの課題に対応するためには、AIのための包摂的なガバナンスを形成することが必要であることを確認する。2023年9月7日に発出されたG7デジタル・技術閣僚声明を含む、関係閣僚による広島AIプロセスの進展を基礎とし、我々は、「高度なAIシステムを開発する組織向けの広島プロセス国際指針」及び「高度なAIシステムを開発する組織向けの広島プロセス国際行動規範」【添付】を歓迎する。両文書は、これらが引き続き目的に適い、かつこの急速に進化する技術に対応したものであることを確保するため、進行中の包摂的なマルチステークホルダー協議を通じたものを含め、必要に応じて見直され、更新される。我々は、高度なAIシステムを開発する組織に対し、国際行動規範の適用にコミットするよう求める。

我々は、関係閣僚に対し、AIに関するグローバル・パートナーシップ(GPAI)及び経済協力開発機構(OECD)との協力の下、プロジェクトベースの協力を含む、「広島AIプロセス包括的政策枠組」の年内の策定に向けたプロセスを加速させること、また、G7のみならず、開発途上及び新興エコノミーを含むG7を超えたエコノミーの政府、学界、市民社会及び民間セクターを含むマルチステークホルダーへのアウトリーチ及び協議を実施することを指示する。我々はまた、関係閣僚に対し、広島AIプロセスを更に前進させるための作業計画を年末までに策定するよう求める。

我々は、広島AIプロセスを通じた我々の共同の取組が、デジタルデバイドの解消及びデジタルの包摂性の達成の観点から、開発途上及び新興エコノミーを含む世界中の共通の利益のために、リスクを軽減しつつ、技術の利益を最大化するため、安全、安心で信頼できるAIシステムが設計、開発、導入及び利用されることを可能とするような開かれた環境を促進すると信じる。我々はまた、11月1日と2日の英国のAI安全性サミットに期待する。

上記のG7首脳声明の主なポイントは以下のとおりです。

広島AIプロセスのこれまでの成果を歓迎するともに、年末に向けて作業を加速化するよう求めるもの。

「高度なAIシステムを開発する組織向けの広島プロセス国際指針」及び「高度なAIシステムを開発する組織向けの広島プロセス国際行動規範」を歓迎する。

年末までの「広島AIプロセス包括的政策枠組」の策定に向けた作業の加速化、及びG7以外も含む、マルチステークホルダーとの協議の実施を指示。

①生成AIに関する優先的な課題、リスク及び機会に関する分析

②開発者を含む全てのAI関係者向けの国際指針

③AI開発者向けの行動規範

④偽情報対策に資する研究の促進等のプロジェクトベースの協力

G7首脳声明の国際指針と国際行動規範

広島AIプロセスに関するG7首脳声明の国際指針と国際行動規範は以下にまとめられています。

■「高度なAIシステムを開発する組織向けの広島プロセス国際指針」(日本語(PDF))

■「高度なAIシステムを開発する組織向けの広島プロセス国際行動規範」(日本語(PDF))

AI開発組織向けの広島プロセス国際指針及び広島プロセス行動規範の概要のポイントは以下のとおりです。

1.高度なAIシステムの市場投入前及び、高度なAIシステムの開発を通じて、AIライフサイクルにわたるリスクを特定、評価、低減するための適切な対策を実施する

2.市場投入後に脆弱性、インシデント、悪用パターンを特定し、低減する

3.十分な透明性の確保や説明責任の向上のため、高度なAIシステムの能力、限界、適切・不適切な利用領域を公表する

4.産業界、政府、市民社会、学術界を含む関係組織間で、責任ある情報共有とインシデント報告に努める

5.リスクベースのアプローチに基づいたAIのガバナンスとリスク管理ポリシーを開発、実践、開示する。特に高度AIシステムの開発者向けの、プライバシーポリシーやリスクの低減手法を含む。

6.AIのライフサイクル全体にわたり、物理的セキュリティ、サイバーセキュリティ及び内部脅威対策を含む強固なセキュリティ管理措置に投資し、実施する

7.AIが生成したコンテンツを利用者が識別できるように、電子透かしやその他の技術等、信頼性の高いコンテンツ認証および証明メカニズムを開発する。またその導入が奨励される。

8.社会、安全、セキュリティ上のリスクの低減のための研究を優先し、効果的な低減手法に優先的に投資する

9.気候危機、健康・教育などの、世界最大の課題に対処するため、高度なAIシステムの開発を優先する

10.国際的な技術標準の開発と採用を推進する

11.適切なデータ入力措置と個人情報及び知的財産の保護を実施する

広島AIプロセスの年内とりまとめに向けて

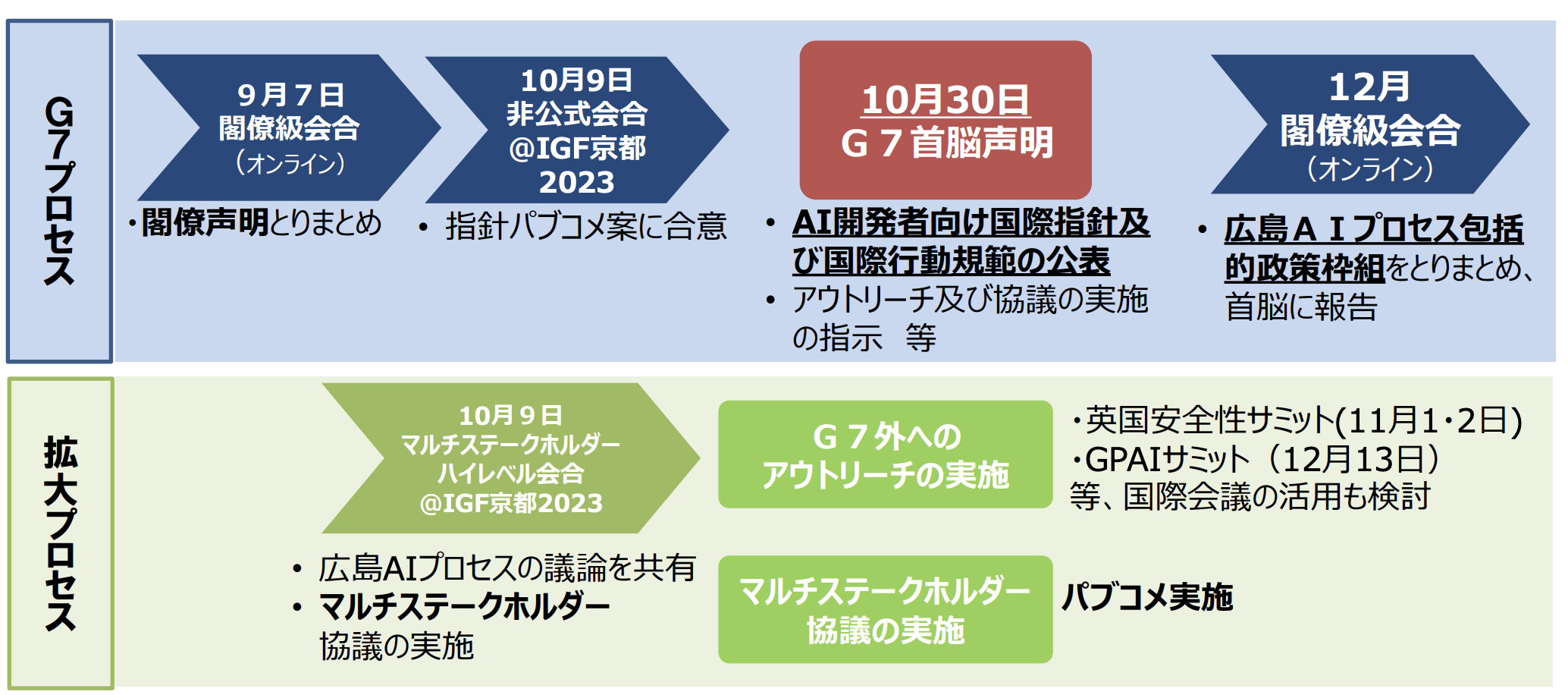

今後の予定として、首脳指示を踏まえ、国内マルチステークホルダーに対する協議(パブコメ)とG7外へのアウトリーチを実施。これらの結果も踏まえ、全てのAI関係者向けの国際指針等の策定作業を引き続き実施し、年末までに再度閣僚級会合(オンライン)を開催し、包括的政策枠組として成果をとりまとめ、G7首脳に報告予定となっています。

具体的な方針としては、12月を目途にG7デジタル技術閣僚級会合をオンラインで開催。パブコメ結果等を踏まえ、閣僚級会合で、以下4点を内容とする「広島AIプロセス包括的政策枠組み」に合意しています。

1.生成AIに関する優先的な課題、リスク及び機会に関する分析

2. AI開発者を含む全てのAI関係者向けの国際指針

3. AI開発者向けの行動規範

4.偽情報対策に資する研究の促進等のプロジェクトベースの協力広島AIプロセスを更に前進させるための作業計画を年内に策定。

広島AIプロセスの今後の進め方

出典:AI戦略会議 第6回 2023.11.7

AI事業者ガイドライン等の行動規範の履行確保及び AI利用の促進の検討も

AI戦略会議では、本年末を目途にAI事業者ガイドライン(案)及び広島AIプロセスの成果である国際的な指針及び開発者向けの行動規範が策定されることを踏まえ、国内におけるAI関連事業者が守るべき行動規範の履行確保(行動規範の遵守に資するインセンティブ確保を含む。以下同じ。)及びAI利用の促進について、以下の通り検討を進めていくことが必要としています。

〇開発者等の行動規範の履行確保措置

・開発者にリスク低減措置等の履行や透明性向上に向けた情報の開示を促すための枠組み(自己宣言や第三者認証・基準認証、外部監査等)

・安全性・脆弱性に関する政府等との情報交換・情報開示の枠組み

・特に大規模AIシステムについては、将来的に社会基盤(又はプラットフォーム)として広く用いられる可能性も踏まえた情報開示等の枠組み

〇提供者等の行動規範の履行確保措置

・リスクの高い分野(政府、金融、エネルギー、運輸、交通、電気通信、放送、医療等)における事前の履行確保措置(業法や業界別自主ルールの現状の把握と追加的ルールの必要性)

・リスクの低い分野におけるガバナンスポリシー等の情報開示の枠組み(上場会社の企業情報開示等)

・人権侵害・法令違反に対する民事法・刑事法の直接適用に加え、不適切な利用が多く見られる脆弱性のあるAIに関する改善措置

・政府調達の活用(信頼できるAIを政府が率先して調達)

今後の検討は、内閣府(科技)において委託調査を行い、履行確保及びAI利用の促進について、外国法制度を含めて年度末までに基礎的な調査を行う。調査の進捗を踏まえ、AI戦略チームやAI戦略会議において具体的な検討を進めていくとしています。

今後の展望

今回の取り組みは、AI関係者向けの国際指針等の策定作業を進め、包括的政策枠組として成果をとりまとめ、G7首脳に報告予定となっています。

広島AIプロセス包括的政策の枠組みをまとめあげるとともに、ガイドラインや行動規範を遵守していく一方で、AIの利活用の促進を進め、社会や産業の課題解決や、新しいビジネスの創造に寄与していくための政策的な後押しとなることも重要となっていくでしょう。