自動運転におけるAI時代の事故責任の在り方

自動運転の普及が進む中において、自動運転による事故責任の在り方についての議論・検討が進められています。

デジタル庁は2023年9月20日、「デジタル臨時行政調査会作業部会(第24回)」を開催し、この中で、デジタル庁からAI時代の事故責任の在り方についての資料が公開されていますので、その内容の一部をとりあげたいと思います。

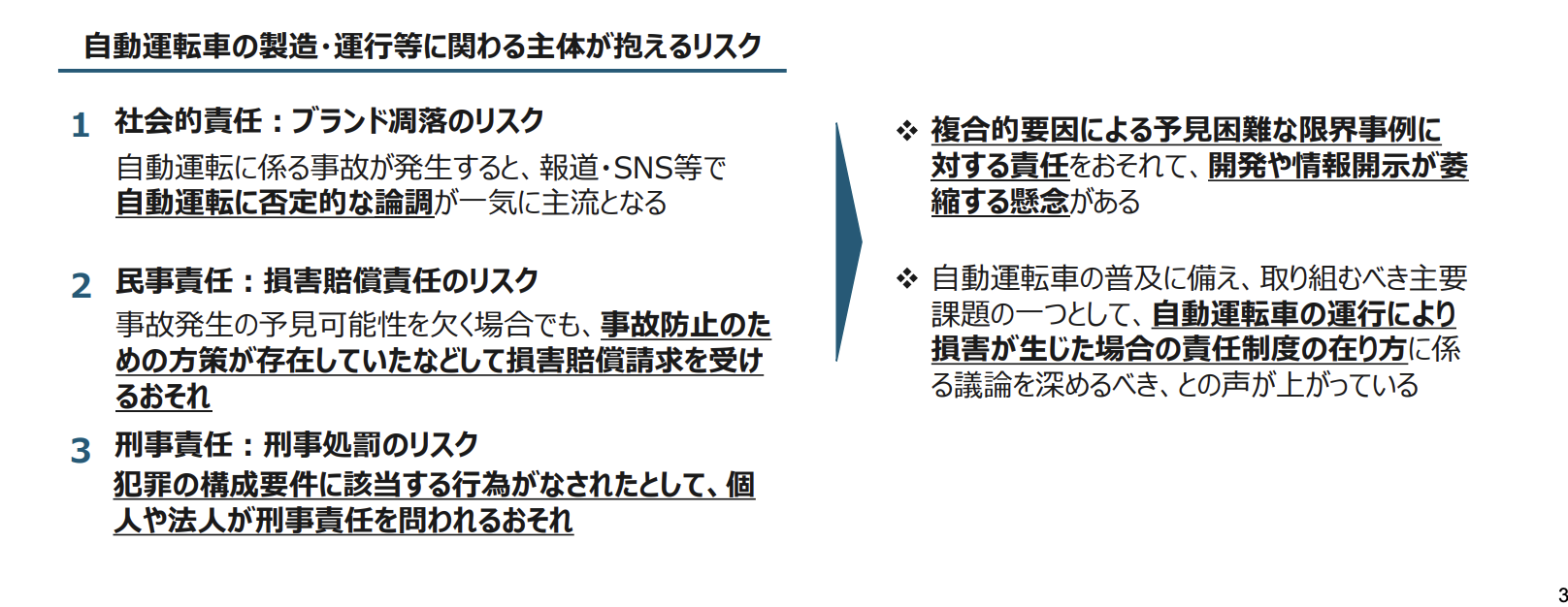

自動運転車の製造・運行等に関わる主体が抱えるリスク

自動運転車の製造・運行などに関わる主体が抱える事故責任のリスクを以下のとおり3つあげています。

社会的責任:ブランド凋落のリスク

自動運転に係る事故が発生すると、報道・SNS等で自動運転に否定的な論調が一気に主流となる

民事責任:損害賠償責任のリスク

事故発生の予見可能性を欠く場合でも、事故防止のための方策が存在していたなどして損害賠償請求を受けるおそれ

刑事責任:刑事処罰のリスク

犯罪の構成要件に該当する行為がなされたとして、個人や法人が刑事責任を問われるおそれ

これらの複合的要因による予見困難な限界事例に対する責任をおそれて、開発や情報開示が萎縮する懸念があるとしています。

出典:デジタル庁 デジタル臨時行政調査会作業部会(第24回) 2023.9

そのため、自動運転車の普及に備え、取り組むべき主要課題の一つとして、自動運転車の運行により損害が生じた場合の責任制度の在り方に係る議論を深めるべき、との指摘があがっています。

こういった状況を踏まえ、デジタル庁では、被害者の迅速な救済を大前提としつつ、特定の者に過度な責任を寄せることを回避し、イノベーションを通じて利便性向上と同時に従来よりも高い安全性の担保が可能となる自動運転システムの実現を目指して、望ましいインセンティブが働くよう環境整備を行う方針です。

目指すべき方向性と想定される論点例

目指すべき方向性と想定される論点例について、システムとルールの観点からまとめています。

<システム>

目指すべき方向性(案)

自動運転車や走行環境のデータ、ヒヤリハットや事故情報を自動的に収集・解析して、事故原因を検証し、官民による適切な情報共有を行いながら、迅速かつ継続的なシステムの改善を行う仕組みの実装

想定される論点例(案)

仕組みの運用にあたって必要となる組織・システムの要件をどう定義すべきか当該組織にどのような権限を付与すべきか(関係当事者に事故調査への協力を求める仕組み等)

<ルール>

目指すべき方向性(案)

適切なリスクマネジメントや調査協力をインセンティブ付ける仕組みの実装

想定される論点例(案)

企業等の自律的・協調的なリスクマネジメントを促す責任制度はどう在るべきか。また、どのように実装すべきか。

その上で、必要に応じて、予見困難な事故に係る免責制度を実装すべきではないか。その場合、マルチステークホルダーの参画を得て免責要件(自動運転関係者が遵守すべき必須要件)の具体化に取り組むべきではないか(迅速に要件をアップデートするための仕組みを含む)。

上記検討に併せ、被害者の救済や企業のリスク軽減等のための保険制度・公的救済制度(リスク計算・保険の設計が困難な場合)等を実装すべきではないか。