IOWNとOCPの提携が描くAI Computing Continuum

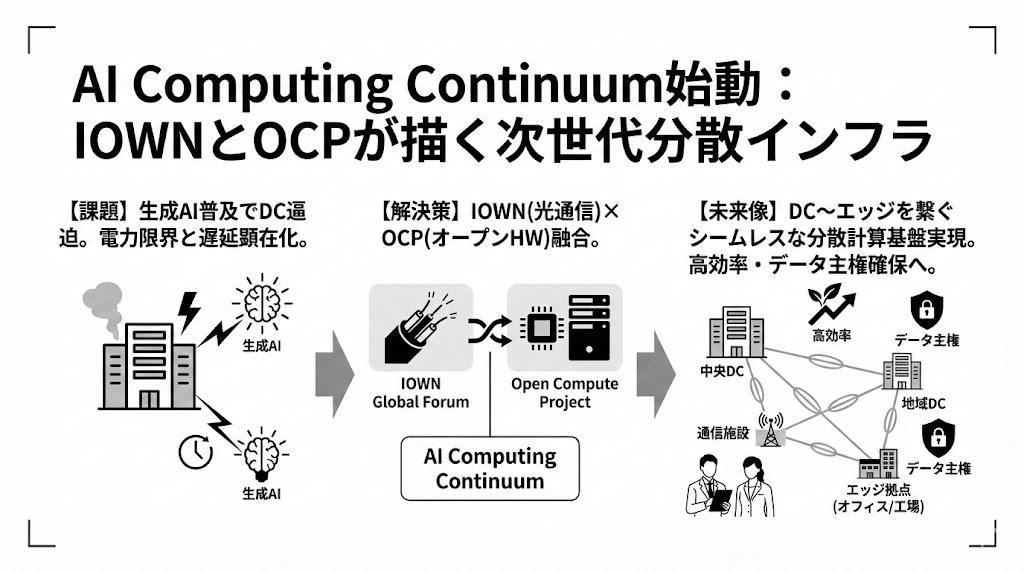

次世代光通信ネットワークを推進するIOWN Global Forumと、オープンなハードウェアインフラを主導するOpen Compute Project(OCP)は2026年2月10日、「AI Computing Continuum」と呼ばれる新たな協業フレームワークを発表しました。

IOWN Global Forum and Open Compute Project Join Forces to Deliver on the Next Wave of AI

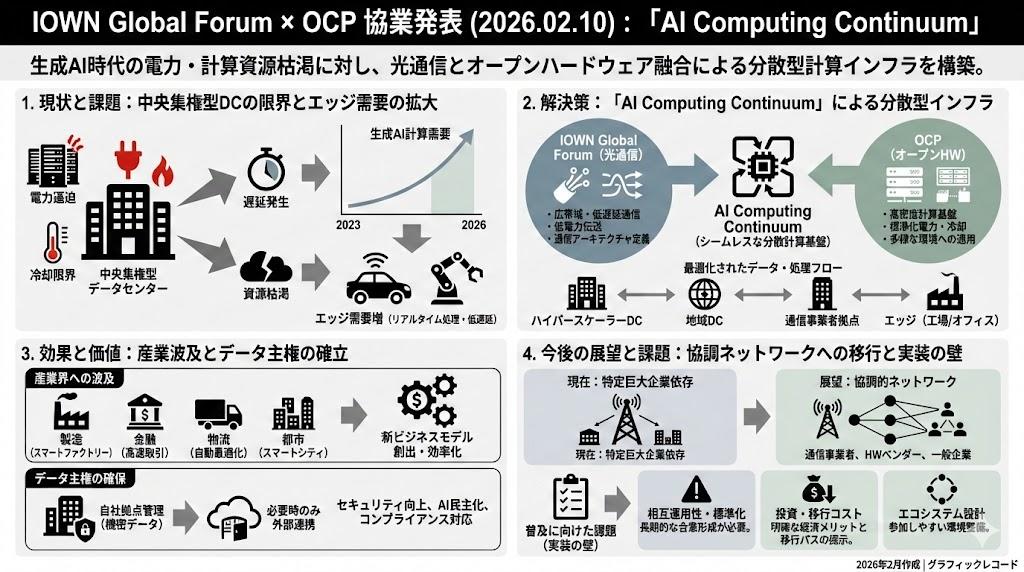

生成AIの急速な普及に伴い、中央集権型のデータセンターにおける電力消費や計算資源の枯渇が深刻な社会課題として浮上しています。この状況に対応するため、両者はデータセンターからエッジ環境に至るまで、シームレスで拡張可能な計算インフラの構築を目指しています。

今回は、次世代AIインフラへの要請、光通信とハードウェアの融合の意義や産業界にもたらす波及効果、そして、今後の展望について取り上げたいと思います。

次世代AIインフラへの要請と提携の背景

生成AIの進化と普及が進む中、計算資源の需要はかつてない規模で拡大しています。大規模な学習モデルを運用するハイパースケーラーのデータセンターでは、電力供給や冷却能力が限界に近づきつつある状況です。それに伴い、データを生成し消費する現場に近いエッジ環境でのAI推論の需要が急速に高まっています。この背景には、遅延の最小化やリアルタイム処理の必要性があります。

IOWN Global ForumとOCPが発表した「AI Computing Continuum」は、こうした課題に対する具体的な回答として位置づけられます。中央集権型のデータセンターだけでなく、地域データセンター、通信事業者の施設、さらには企業のオフィスや工場などの分散した拠点をつなぎ、ひとつの連続した計算基盤として機能させる構想です。これにより、計算のパフォーマンスと電力効率を最適化することが期待されます。両組織の提携は、通信アーキテクチャの革新とハードウェアの標準化という双方のアプローチを統合するものであり、今後のインフラ設計において重要となります。

中央集権型から分散型コンピューティングへの移行

これまで、AIの開発や運用は、巨大な資本を持つ一部の企業が構築した中央集権型のデータセンターに依存してきました。一極集中型のシステムは、規模の経済を働かせる上で効率的であったといえます。一方で、データ通信量の増大によるネットワークの逼迫や、遅延の問題が現場での摩擦を生んでいます。自動運転や産業用ロボット、高度な金融取引など、ミリ秒単位の応答が求められる領域では、通信の遅れが致命的な結果を招くことが想定されます。

この課題を解決するためには、エッジ側での計算能力を強化し、分散型のコンピューティング環境へと移行することが必要となります。ただ、拠点ごとに異なる規格のハードウェアやソフトウェアを導入することは、運用コストの増大や管理の複雑化を招きます。多様な環境をシームレスに統合し、計算資源を効率的に割り当てることができる共通のアーキテクチャが求められています。今回の協業は、こうした現場の課題を解消し、分散環境における高いパフォーマンスの実現を目指すものと考えられます。

光通信とオープンハードウェアの融合がもたらす価値

AI Computing Continuumの実現に向け、IOWN Global ForumとOCPはそれぞれの強みを活かした役割分担を示しています。IOWN Global Forumは、光ベースの通信技術やデバイス技術を活用し、広帯域かつ低遅延の通信アーキテクチャを定義します。光通信技術は、大容量のデータを高速かつ低電力で伝送することを可能にし、地理的に分散した拠点間のボトルネックを解消する役割を担います。

これに対してOCPは、インフラストラクチャを提供するために必要なオープンハードウェアの仕様を策定します。ハイパースケールデータセンターで培われた高密度な計算プラットフォームや、標準化された電力・冷却ソリューションの設計を、エッジを含む多様な環境へと適用させます。ネットワーク技術とハードウェア技術が統合されることで、インフラ全体の効率性が飛躍的に高まるでしょう。両者の技術が融合することで、初めてシームレスな分散コンピューティング環境が構築されるといえます。

産業界への波及影響とデータ主権の確保

この新たなインフラストラクチャは、金融、製造、エンターテインメント、物流、都市開発など、さまざまな産業に多大な波及効果をもたらすことが期待されます。IOWN Global Forumは、これらの産業における早期導入に向けたユースケースのシステム設計を提供するとしています。各業界に特有の要件に対応しつつ、インフラを最適化することで、新たなビジネスモデルの創出が想定されます。

また、企業が自社のデータを外部の中央集権型クラウドに依存することなく、自らの管理下で運用できる「データ主権」の維持も重要なテーマです。AIの活用において、機密性の高いデータを外部に持ち出すことへの懸念は根強く存在します。分散型のインフラが整備されれば、企業は自社の拠点内でデータを処理しながら、必要なときだけ外部のリソースと連携することが可能になります。これは、企業のAI活用を民主化するだけでなく、セキュリティやコンプライアンスの観点からも大きな意義を持つと考えられます。

普及に向けた課題と標準化の実効性

革新的な構想が提示された一方で、その社会実装にはいくつかの壁が存在します。複数の事業者が参画する分散環境において、ハードウェアとソフトウェアの相互運用性をいかに担保するかが最大の焦点となります。異なるベンダーの機器が混在する中で、共通の仕様を策定し、それを実効性のある標準として定着させるには、長期的な合意形成が必要となります。

さらに、通信インフラの刷新には莫大な投資が求められています。初期導入におけるコストや、既存のレガシーシステムからの移行プロセスに対する明確な道筋が示されなければ、企業は投資を躊躇するでしょう。技術・経済的な分析を通じて、環境面や経済面でのメリットを具体的に提示することが求められています。構想の実現には、技術の優位性だけでなく、関連企業が参加しやすいエコシステムの設計が決定づけられるといえます。

今後の展望

AI Computing Continuumの進展により、次世代のITインフラは特定の巨大企業に依存する構造から、多様なプレイヤーが参加する協調的なネットワークへと移行していくと予想されます。通信事業者やハードウェアベンダーにとって新たな市場機会を創出するだけでなく、一般企業のデータ活用戦略を再構築する契機となるでしょう。

åå