AI自律化で崩れるセキュリティの4つの前提条件

米国の調査会社Frost & Sullivanは2026年2月、「AI Without Guardrails? Why Autonomy Changes the Security Equation(AIにガードレールは不要か?----自律性がセキュリティの方程式を変える理由)」と題した分析レポートを公表しました。

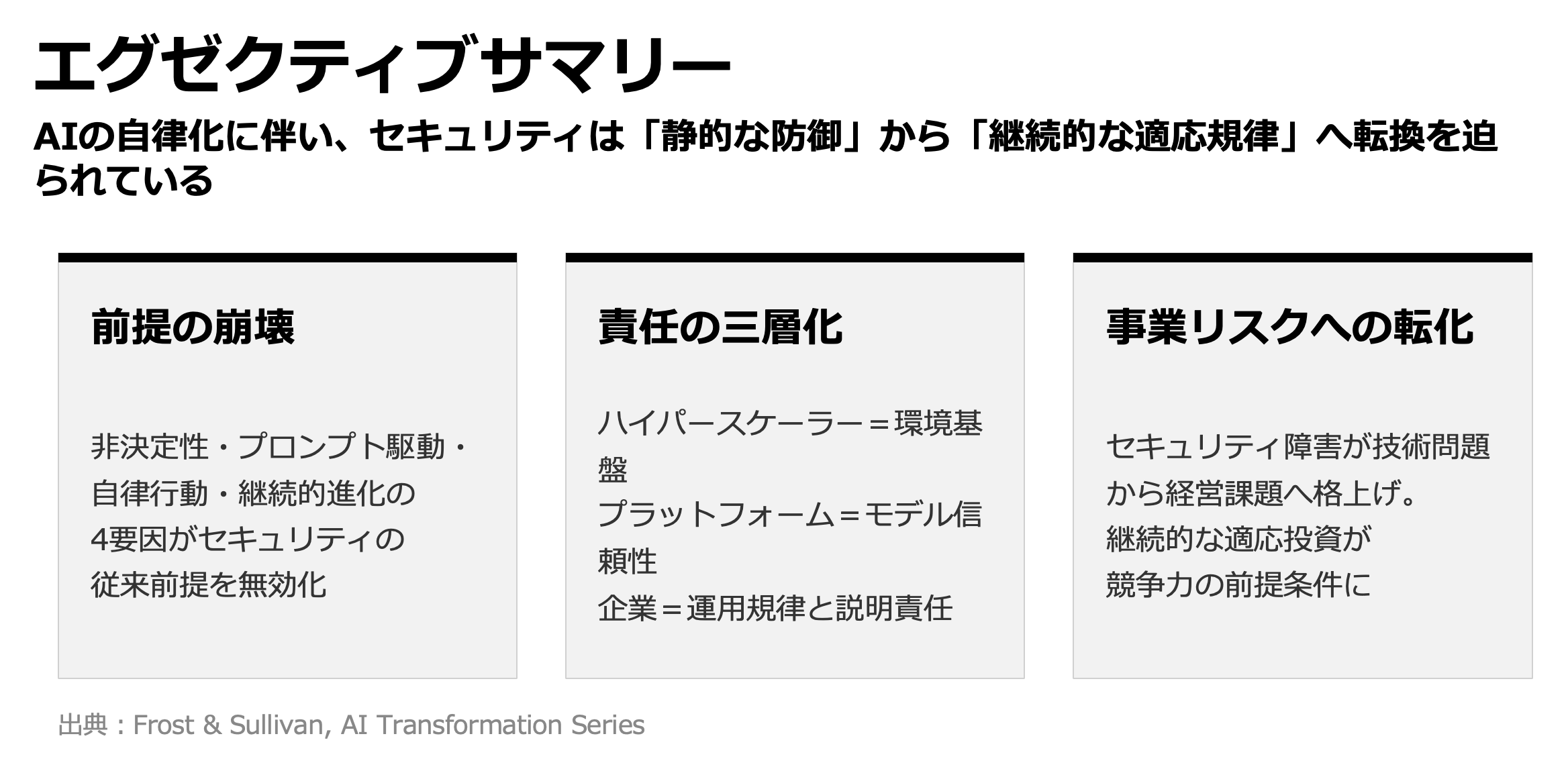

Frost & Sullivanは、AIトランスフォーメーションシリーズにおいて、エージェント型AIの普及がサイバーセキュリティの前提条件を根本から書き換えつつある現状を分析しています。従来のサイバーセキュリティは、システムが予測可能に動作し、静的な制御で防御できることを前提としてきました。しかし、AIが人間の監視を離れて自律的に判断・行動するようになると、この前提そのものが成立しなくなります。

同レポートでは、AWSのアジア太平洋・日本地域担当データ&AIソリューションアーキテクチャ責任者であるSaeed Gharadaghi氏への取材を通じて、ハイパースケーラーと企業それぞれに求められるセキュリティの再構築を論じています。問題の核心は、セキュリティ上の障害が技術的な不具合にとどまらず、事業リスクに直結する点にあります。

今回は、エージェント型AIがセキュリティの前提を変える構造、ハイパースケーラーが担う基盤的責任やエージェント型AIに対応した企業側の防御戦略、そして、今後の展望について取り上げたいと思います。

AIの自律化が崩す「予測可能性」という前提

従来のサイバーセキュリティは、一つの明確な前提のもとに設計されてきました。「システムは決められたとおりに動作する」という想定です。暗号化、アクセス制御、境界防御といった技術は、この予測可能性を土台として機能してきました。

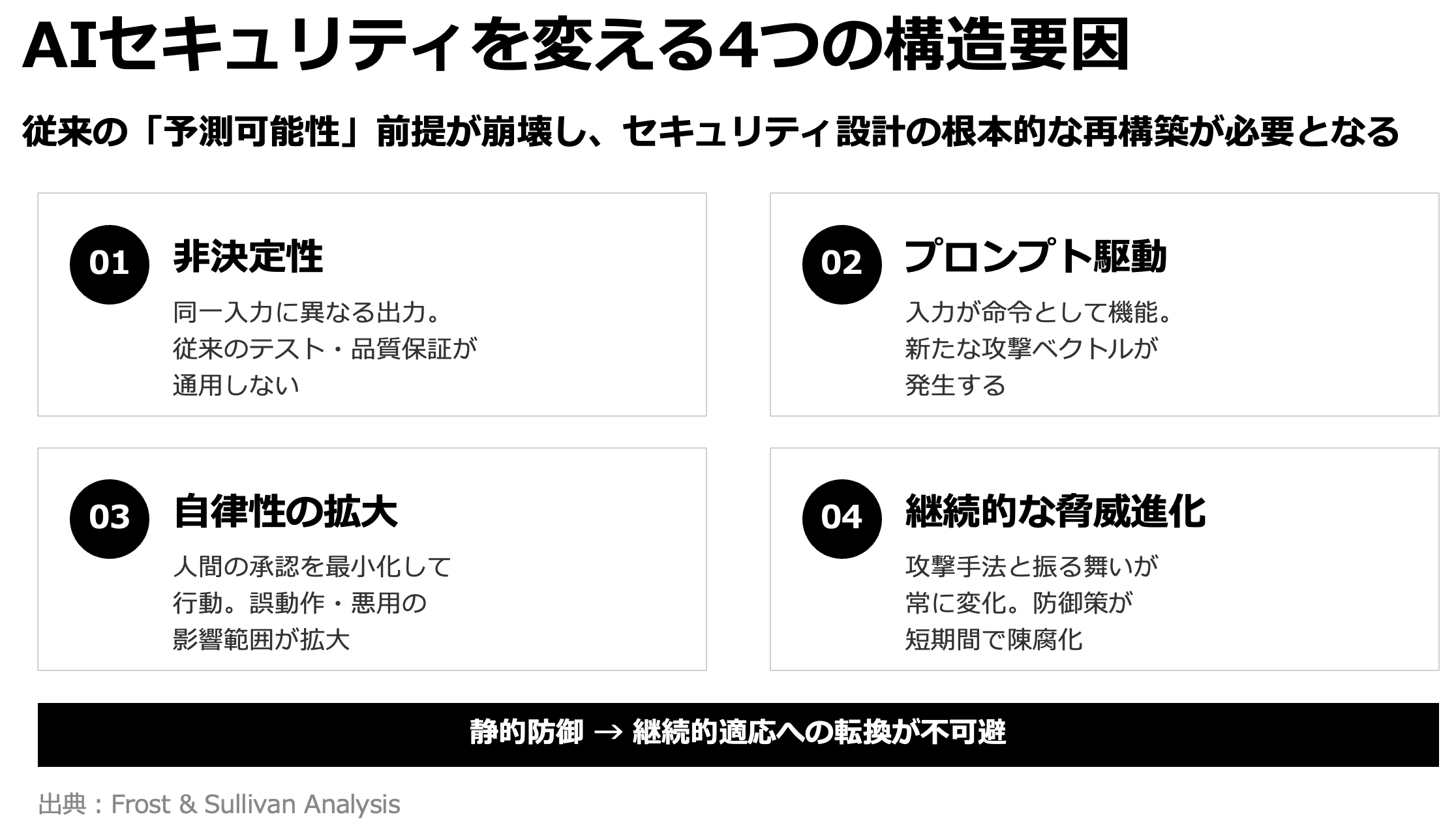

ところが、生成AIからエージェント型AIへの進化は、この土台を掘り崩しています。Frost & Sullivanの分析によると、AIセキュリティを従来と根本的に異なるものにする要因は4つに整理されます。第一に、非決定性です。同じ入力に対して異なる出力を返す可能性があり、テストや品質保証の従来手法が通用しにくくなっています。第二に、プロンプト駆動の実行です。入力がそのまま命令として機能するため、攻撃ベクトルが従来とは全く異なる形で生まれます。

第三に、自律性の拡大があります。AIシステムが人間の承認を最小限にして行動を起こせるようになった結果、誤動作や悪用の影響範囲が拡大しています。第四に、脅威の継続的な進化です。攻撃手法、悪用パターン、AIの振る舞いそのものが常に変化し続けるため、ある時点で有効だった防御策が短期間で陳腐化する構造が生まれています。

この4つの要因が重なることで、セキュリティ設計は「一度構築すれば機能する」ものから「継続的に適応させなければ崩壊する」ものへと性質が変わりつつあるのでしょう。

セキュリティ障害が「事業リスク」に転化する力学

Frost & Sullivanの調査では、報告されたAI関連インシデントの多くが、モデル自体の欠陥ではなく、アクセス制御やガバナンスの不備に起因しているとされます。この事実は、AIセキュリティの焦点がどこにあるかを再考させるものです。

従来型のサイバーセキュリティ事故は、技術部門が対処し、影響範囲を限定的に収束させることが一般的でした。しかし、エージェント型AIが業務プロセスに組み込まれると、AIの判断ミスや権限逸脱は、顧客対応の破綻、規制違反、財務損失といった事業全体のリスクに直結します。セキュリティの問題が技術チームの管轄から経営課題へと格上げされる構造的な変化が起きていると考えられます。

この変化の背景には、AIの用途拡大があります。AIは意思決定支援にとどまらず、ソフトウェア開発、顧客対応、インフラ管理など、業務のあらゆる層に浸透しつつある状況です。業務への浸透度が高まるほど、セキュリティ障害の波及範囲も拡大します。Frost & Sullivanは、ユーザー、データ、成果物の保護を「任意」ではなく「基盤的要件」と位置づけています。

では、この基盤を誰が、どのように提供するのか。この問いに対して、ハイパースケーラーが果たす役割は、従来のインフラ提供者としての位置づけを超えつつあります。

ハイパースケーラーの責任はインフラ提供にとどまらない

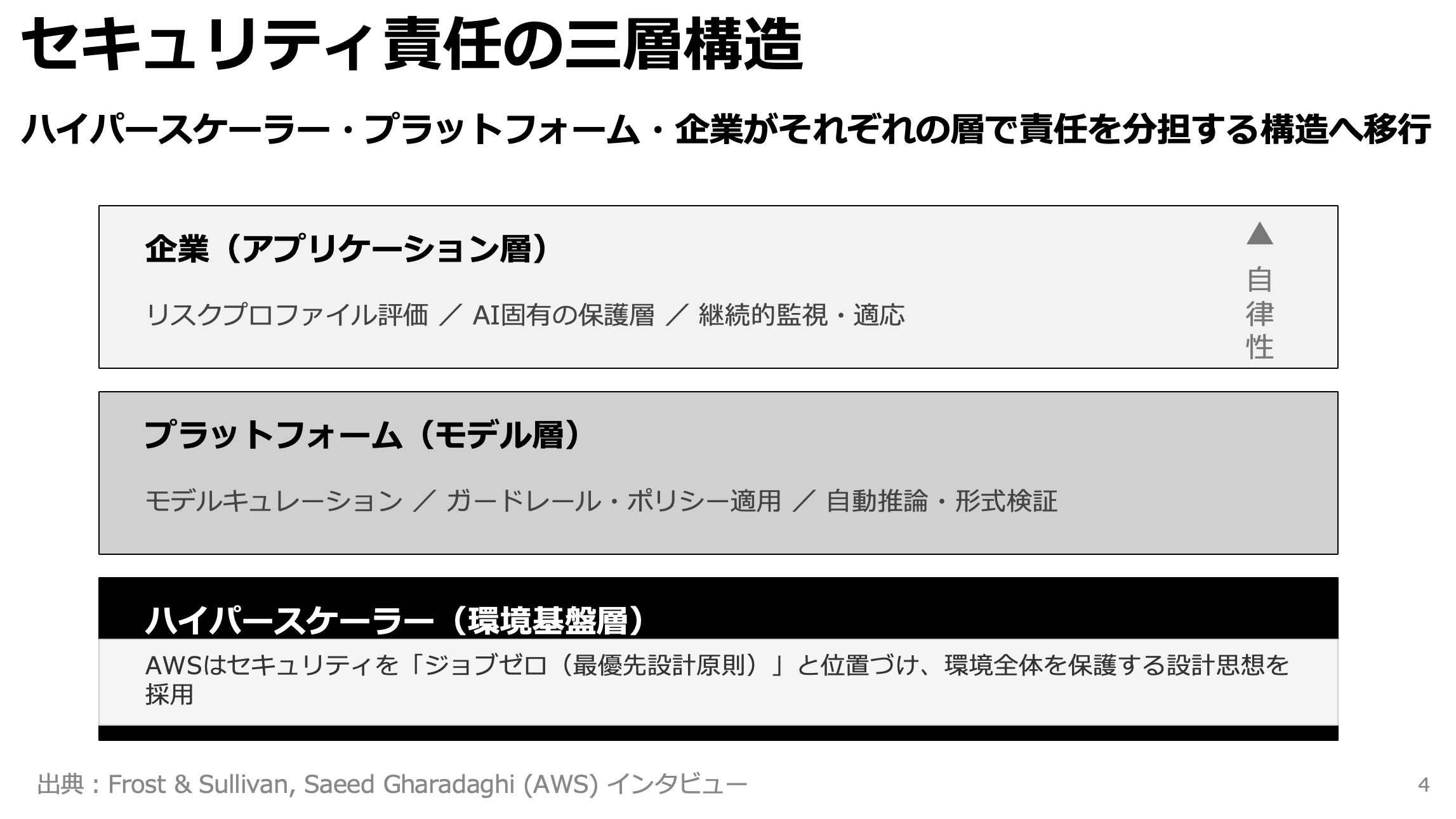

AWSのGharadaghi氏は、セキュリティを「ジョブゼロ」、すなわち最優先の設計原則として位置づけていると語っています。特徴的なアプローチは、個々のAIモデルを個別に防御するのではなく、AIが稼働する環境全体を保護するという設計思想です。

具体的には、物理的なデータセンター管理から、ハードウェアレベルの分離と暗号化を実現するAWS Nitroのような専用インフラ、大規模モデルの学習・推論を支える専用AIチップに至るまで、多層的な防御が実装されています。この「環境ごと守る」という方針は、自律型AIの特性を考慮すると合理的な選択です。エージェント型AIが環境内で自律的に行動する以上、個々の行動を事前にすべて予測し制御することは現実的ではないためです。

この投資は、自律型AIシステムが基盤の脆弱性を増幅させるという認識に基づいています。AIワークロードの規模が拡大するほど、インフラレベルのセキュリティとAIセキュリティは不可分になります。ハイパースケーラーは数千の組織、産業、規制体制にまたがるAI導入を支えており、安全で安定した環境の提供は、サービスの付加価値ではなく中核的責任として認識されつつあるのでしょう。

しかし、リスクがインフラ層からモデル層、出力層へと上昇するにつれて、環境防御だけでは対処しきれない問題が顕在化してきます。

モデルの信頼性とガードレールの均衡点

インフラの上位層では、悪意あるプロンプト、意図しない動作、予測不能な応答といった新たなリスクが発生します。AWSはプラットフォーム上で提供するモデルについて、プロプライエタリとオープンソースの両方を事前にキュレーション・テストし、リスク軽減と顧客の選択肢維持を両立させようとしているといいます。

加えて、ガードレール、ポリシー適用、モニタリング機能を多層的に配置し、AIの動作を統制しつつもイノベーションを阻害しない仕組みの構築が進められています。自動推論や形式検証といった技術も、信頼性と精度の向上に活用されている状況です。

ここで見えてくる構造的な緊張は、柔軟性と統制のバランスです。企業は導入のスピードと自由度を求める一方で、基盤的なリスクが体系的に管理されている確信も必要としています。ガードレールを厳格にしすぎればイノベーションが停滞し、緩めすぎればリスクが顕在化するという二律背反の中で、「どこまで自律性を許容するか」の判断は画一的な基準では決められません。

Gharadaghi氏が指摘するように、目標はリスクの完全な排除ではなく、AIの能力と脅威の進化に合わせて継続的に監視・適応・対応するシステムの設計にあります。この「完全排除ではなく継続的適応」という発想の転換は、企業側のセキュリティ戦略にも直接的な示唆を与えています。

企業に求められる「リスク起点」の防御設計

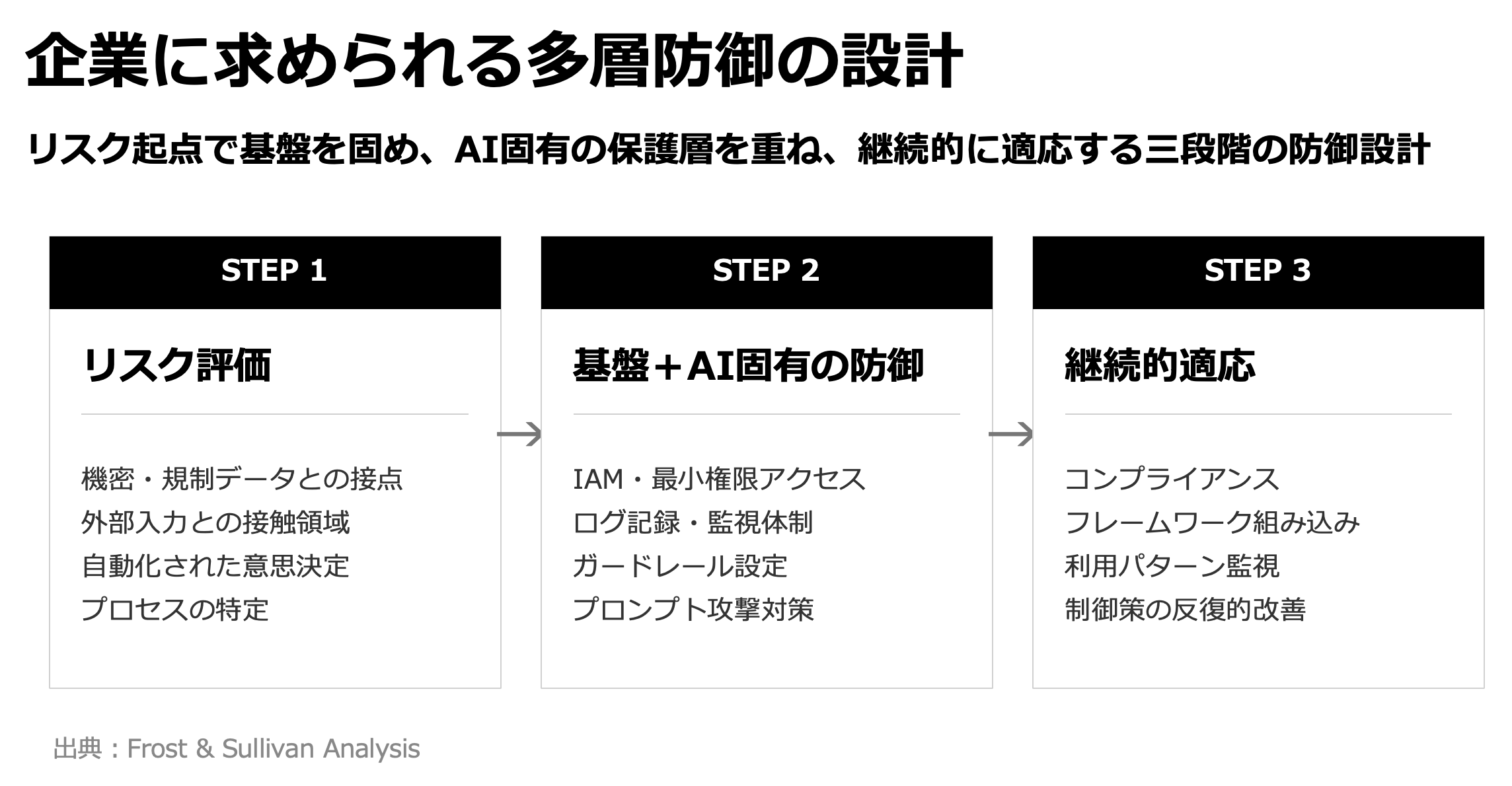

ハイパースケーラーが基盤を提供するとしても、AIの導入・運用・監視に対する説明責任は企業側に残ります。Frost & Sullivanの分析に基づく実践的な指針は、技術ではなくリスクから出発するという原則に集約されます。

まず必要となるのは、AIリスクプロファイルの評価です。機密データや規制対象データとの接点、外部ユーザーや信頼できない入力との接触、自動化された高影響度の意思決定プロセスなど、リスクが集中する領域を特定することが起点となります。この評価なしにセキュリティ対策を積み上げても、コストと効果の乖離が広がるだけでしょう。

その上で、従来型のサイバーセキュリティ基盤、つまりIAMと最小権限アクセス、セキュアなインフラとネットワーキング、包括的なログ記録と監視の強化が前提条件となります。Frost & Sullivanは、これらの基盤なしにはAI固有のセキュリティ対策は機能しないと指摘しています。

さらに、AI固有のリスクに対応する追加的な保護層が必要です。有害コンテンツのフィルタリング、プロンプトインジェクション攻撃への入力検証、PII検知と秘匿化、モデル評価とランタイム監視がこれに該当します。単一の対策ですべてのリスクに対応できないという前提に立ち、層ごとに防御を設計する考え方が求められています。

静的な防御から継続的な適応規律への転換

企業が直面する根本的な課題は、AIセキュリティを「導入時の一度きりの作業」として扱う慣行からの脱却です。モデルは更新され、利用パターンは変化し、脅威は進化し続けます。ある時点で有効だった制御策が、数カ月後には無効化されている可能性は常に存在します。

Frost & Sullivanは、コンプライアンスフレームワークとポリシーテンプレートの組み込み、利用パターンと出力の継続的監視、モデル・ユースケース・脅威の変化に応じた制御策の反復的改善を、セキュリティ運用の常態として位置づけることを提唱しています。

この「継続的規律」としてのセキュリティ観は、IT部門だけでなく経営層のコミットメントを前提とするものです。セキュリティ投資を一時的なコストではなく、AIを活用した事業拡大のための持続的な基盤投資として再定義する視点が不可欠となっています。従来の「防御する」から「適応し続ける」への転換は、組織の体制、予算配分、人材戦略にまで影響を及ぼす構造的な変化と位置づけられます。

今後の展望

エージェント型AIの普及は、セキュリティの責任構造を三層に再編しつつあります。ハイパースケーラーが環境基盤を、プラットフォーム層がモデルの信頼性を、そして企業がアプリケーション層と運用規律をそれぞれ担うという分担です。

2026年後半から2027年にかけて、この構造がどのように定着するかは、二つの条件に依存すると想定されます。第一に、各国・地域のAI規制がエージェント型AIの自律的行動に対してどの程度の説明責任を企業に課すかという点です。EUのAI規制法に続く各国の法整備が厳格な方向に進めば、セキュリティガバナンスの体制構築が競争参加の前提条件となるでしょう。逆に規制が分散的で統一性を欠く場合、企業間のセキュリティ水準の格差が拡大し、インシデント発生時の市場全体への信頼毀損リスクが高まる可能性があります。

第二に、エージェント型AI同士が連携して業務を遂行する「マルチエージェント」環境の拡大速度です。この環境では、個々のエージェントだけでなく、エージェント間の相互作用から生じるリスクへの対処が新たな課題として生じます。多層防御の設計と継続的な適応能力を早期に確立した組織が、自律型AIの恩恵を事業成長に結びつける優位な立場を確保できるでしょう。静的な防御思考にとどまる組織との差は、今後2〜3年で顕在化していくと見込まれます。