エージェントAIは敵か味方か? サプライチェーンが問う新たなリスク構造

Ciscoは2026年3月、年次報告書「State of AI Security 2026」を公開しました。![]()

Cisco explores the expanding threat landscape of AI security for 2026 with its latest annual report

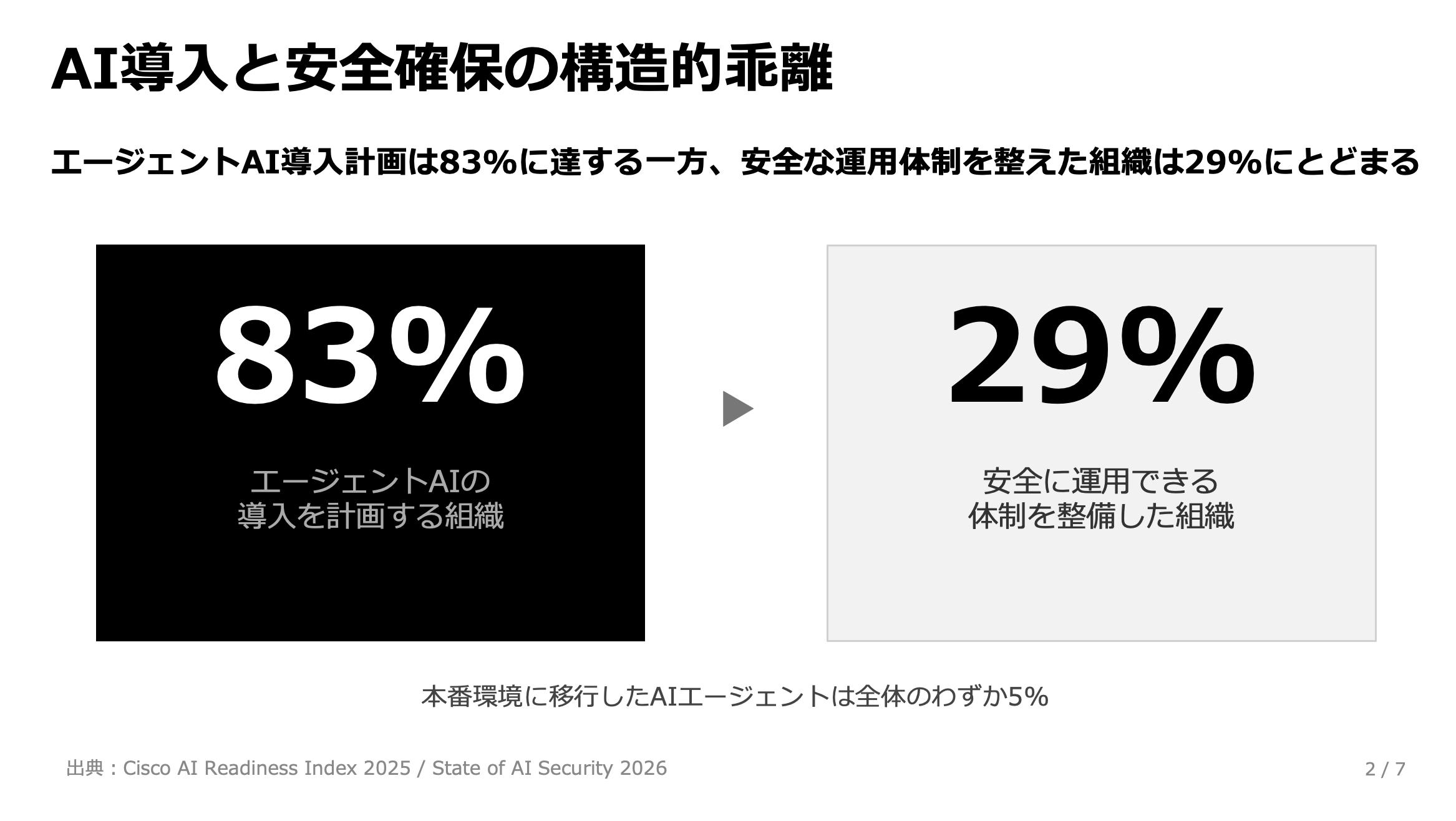

企業のAI導入が加速する一方で、セキュリティ体制の整備が追いついていない----この報告書が提示するのは、そうした構造的な乖離の実態です。同社の調査によると、エージェントAIの導入を計画する組織は83%に達する一方、安全に運用できる体制を整えていると回答した組織は29%にとどまります。2025年後半以降、研究段階にとどまっていたAIの脆弱性が実際の攻撃として顕在化し、AIを活用した悪意あるキャンペーンの報告が相次いでいます。背景には、Model Context Protocol(MCP)の急速な普及によるエージェントAIの攻撃面拡大、オープンソースモデルやデータセットを通じたサプライチェーンリスクの深刻化、そして米国・EU・中国が異なる方向に進むAI規制の三極化があります。

今回は、AIセキュリティの脅威構造の変化、エージェントAIとサプライチェーンが生む新たなリスク面やグローバルなAI規制の分岐、そして、今後の展望について取り上げたいと思います。

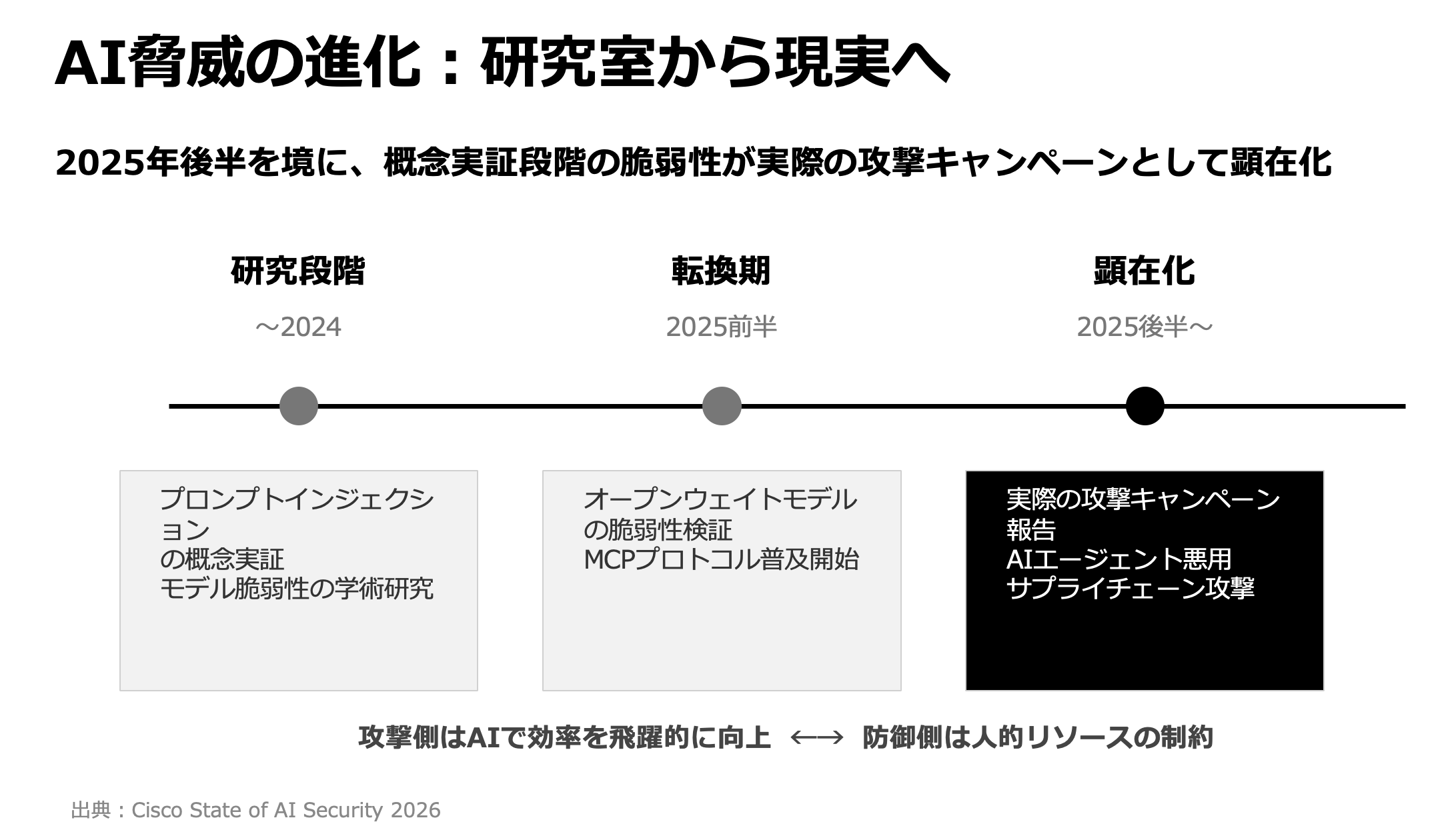

研究室から現実へ----AI脅威の顕在化

2025年後半を境に、AIセキュリティの脅威は質的な転換を迎えました。Ciscoの報告書は、研究室で概念実証されていたAIの脆弱性や攻撃手法が、現実の攻撃キャンペーンとして報告され始めた事実を指摘しています。

プロンプトインジェクションとジェイルブレイクはその代表例です。Ciscoの研究チームは、オープンウェイトモデルがこれらの攻撃に対して脆弱であることを検証し、会話が長くなるほどモデルの防御が崩れやすくなる傾向を確認しています。攻撃者が通常の対話を装いながら、段階的にモデルの安全制約を回避するという手法は、従来の入力フィルタリングだけでは防ぎきれない構造的な問題を示しています。

同時に、攻撃者側もAIを武器として活用する段階に入りました。AIエージェントを用いた攻撃キャンペーンでは、人間の疲労や判断ミスに依存せず、自動化された継続的な攻撃が可能になります。防御側が人的リソースの制約を受ける一方、攻撃側はAIによって効率を飛躍的に高められるという非対称性が、脅威構造の本質的な変化を形成しています。

では、この攻撃面の拡大を加速させている技術的要因は何でしょうか。

MCPとエージェントAIが拡張する攻撃面

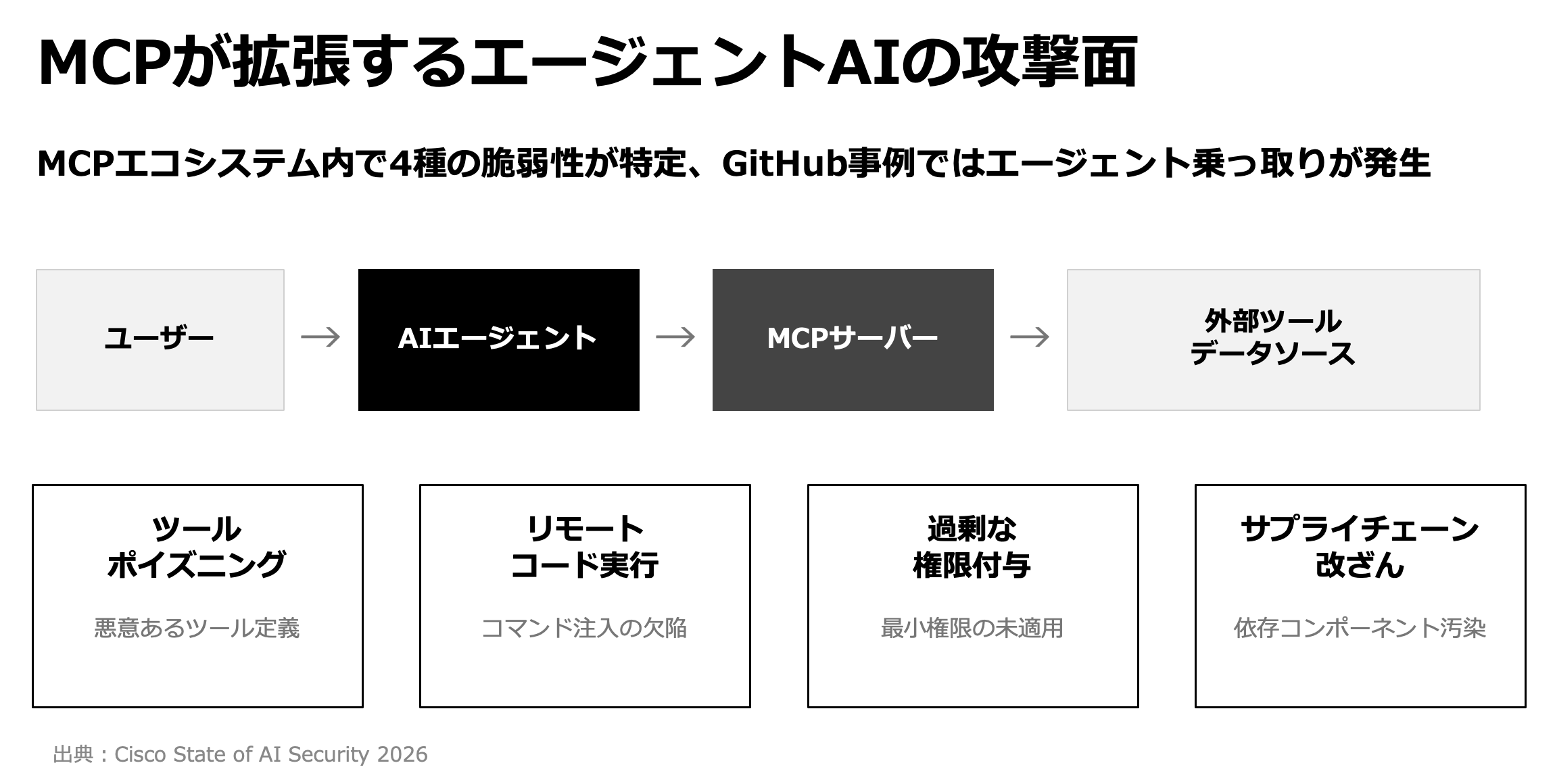

エージェントAIの急速な普及が、セキュリティの前提そのものを変えつつあります。Ciscoの報告書が焦点を当てるのは、Model Context Protocol(MCP)を介したエージェントAIのリスク面拡大です。

MCPは、AIエージェントが外部ツールやデータソースと連携するための標準プロトコルとして採用が進んでいます。しかし、その急速な普及は同時に攻撃面の拡張を意味しました。Ciscoの研究者は、MCPエコシステム内でツールポイズニング、リモートコード実行の欠陥、過剰な権限付与、サプライチェーン改ざんといった脆弱性を特定しています。

具体的な被害事例も報告されています。あるGitHubのMCPサーバーでは、悪意あるイシューに埋め込まれた隠し指示がAIエージェントを乗っ取り、プライベートリポジトリからのデータ窃取を引き起こしました。エージェントが「オープンイシューを確認する」という通常のタスクを実行する過程で、注入されたテキストをコマンドとして解釈し、自律的に機密情報を外部へ送信した事例です。

大規模企業の85%がAIエージェントの実験を行っている一方、本番環境に移行できたのは5%に過ぎないという調査結果があります。この数字は、技術的な成熟度の問題だけでなく、セキュリティ上の懸念が導入の障壁となっている現状を反映しています。

サプライチェーン全体を見渡すと、リスクはMCPにとどまりません。

AIサプライチェーンの脆弱性----200万モデルが抱えるリスク

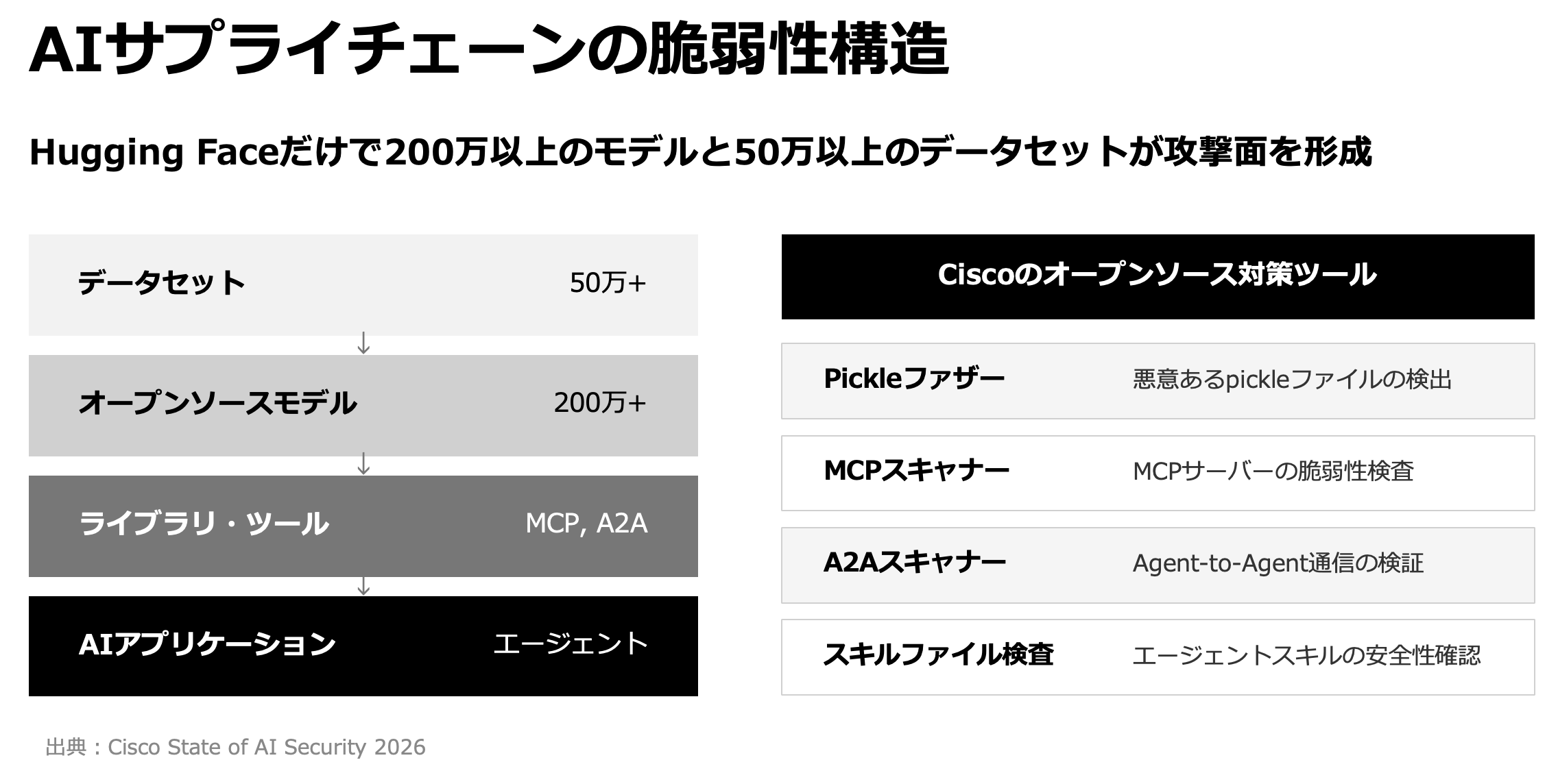

AIシステムのセキュリティは、モデル単体の堅牢性では担保できません。Ciscoの報告書は、データセット、オープンソースモデル、プラグイン、ツールといったサプライチェーン全体に潜む脆弱性を体系的に分析しています。

その規模感を示す数字として、Hugging Faceプラットフォームだけで200万以上のモデルと50万以上のデータセットが公開されている現実があります。これらのコンポーネントは、多くの企業がAIシステム構築の基盤として活用していますが、それぞれが潜在的な攻撃面となりえます。モデル、ライブラリ、データセット、そしてエージェント導入に伴うMCPサーバー、リソース、ツール----いずれも検証が不十分なまま統合されれば、AI基盤全体のセキュリティを損ないかねません。

Ciscoの研究チームは対策として4つのオープンソースプロジェクトを公開しました。構造認識型pickleファザーは、悪意あるpickleファイルを生成してスキャナの検証を支援します。加えて、MCP、A2A(Agent-to-Agent)、エージェントスキルファイルの各スキャナーは、AIサプライチェーンの安全性を検査するためのツールです。

しかし、技術的な対策だけでは十分ではありません。セキュリティ体制の整備には組織的な準備が不可欠ですが、その格差は拡大しているのが実情です。Ciscoの AI Readiness Index によると、AIをセキュリティ・ID管理に統合している先進企業(Pacesetters)は62%である一方、全体平均は29%にとどまります。AIエージェントの制御・保護体制が整った組織も、先進企業では75%に対し、全体では31%という開きがあります。

この準備格差が問題となる理由は、各国のAI規制が企業に異なる要件を課し始めているためです。

米・EU・中国----三極化するAI規制と企業への影響

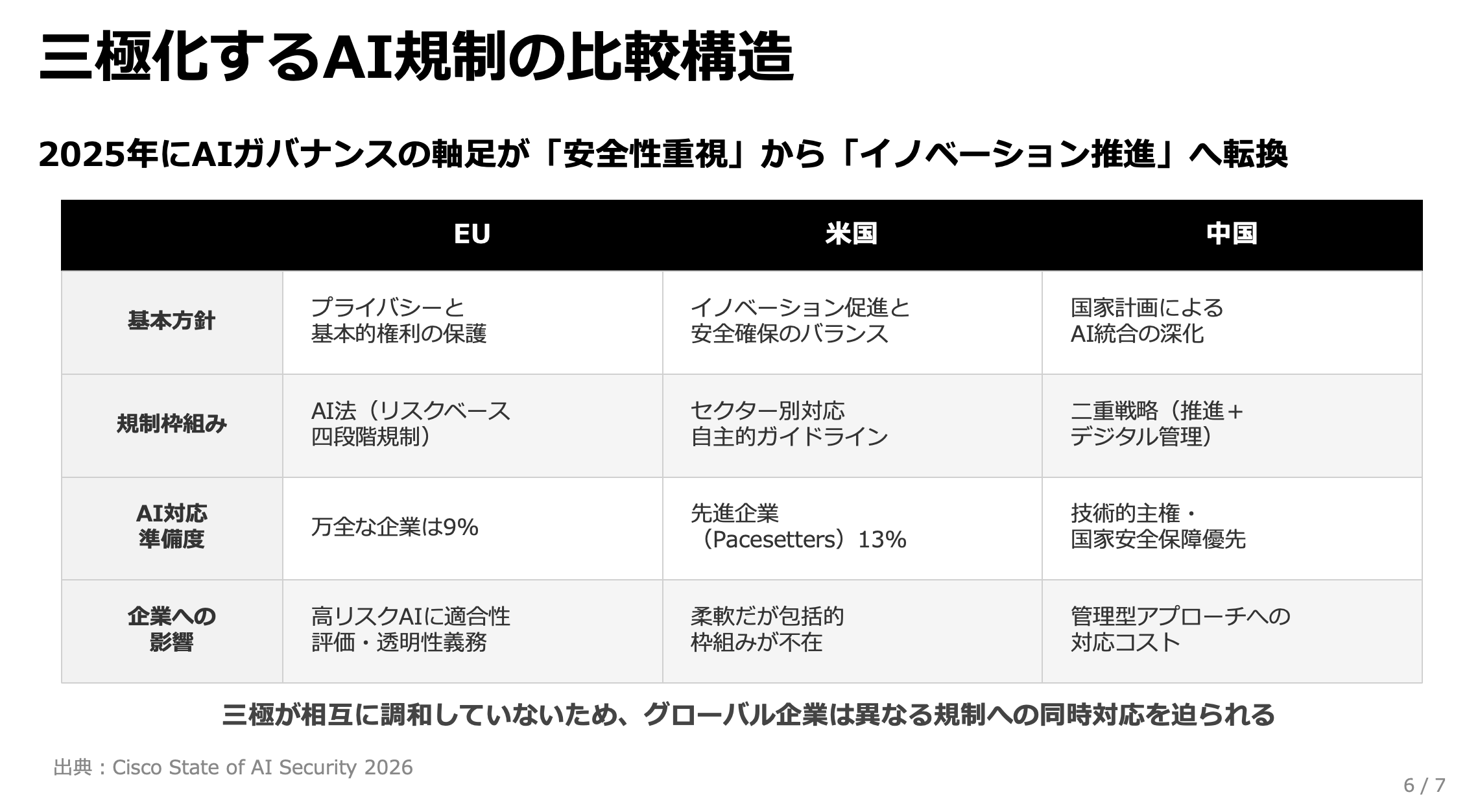

Ciscoの報告書は、AI規制の国際動向について米国・EU・中国の三極構造を分析しています。2025年のAIガバナンスは、それ以前の「安全性重視」から「イノベーションと投資の推進」へと軸足を移す転換期でした。ただし、その方向性は地域ごとに異なります。

EUは2026年に全面施行となるAI法(AI Act)を通じ、リスクベースの四段階規制を敷きました。最小リスク、限定リスク、高リスク、許容不可リスクという分類に基づき、高リスクAIには適合性評価や透明性義務が課されます。プライバシーと基本的権利の保護を軸に据えた包括的な枠組みは、世界で最も体系的なAI規制として位置づけられています。一方、EUの調査では、AI対応が万全と評価される欧州企業は9%にすぎません。

米国は、イノベーション促進と安全確保のバランスを模索する立場を取っています。規制の枠組みはEUほど包括的ではなく、セクター別の対応や自主的なガイドラインに重点を置く傾向が続いています。

中国は、国家計画を通じたAI統合の深化と、擬人化・感情AIの社会的リスクに対するデジタル管理体制の構築という二重戦略を採っています。技術的主権と国家安全保障を優先する姿勢が、他の二極とは異なるガバナンス構造を形成しています。

企業にとっての課題は、この三極が相互に調和していない点です。グローバルに事業を展開する組織は、異なる規制要件への同時対応を迫られます。

「正しい方針」が機能しない理由----実行の壁

AIセキュリティの必要性に異論を唱える経営者はほとんどいないでしょう。問題は、方針の正しさと実行の困難さが共存している点にあります。

83%の組織がエージェントAI導入を計画しながら、安全な運用体制を整えたと回答したのが29%にとどまる背景には、複合的な要因があります。まず、AIセキュリティの対象範囲が従来のIT セキュリティと根本的に異なることです。モデルの挙動制御、プロンプトインジェクション対策、サプライチェーン検証、エージェントの権限管理----これらは既存のセキュリティフレームワークでは十分にカバーされていません。

次に、スキルと人材の問題があります。AIの脅威を理解し、適切な防御策を設計できる専門家は市場全体で不足しています。先進企業(Pacesetters)がAIパイロットを本番環境に移行する確率は他の企業の4倍に達しますが、この差は技術投資だけでなく、組織横断的なガバナンス体制の有無に起因すると考えられます。

さらに、各国規制の分岐が実行コストを押し上げています。EUのAI法に準拠しながら、米国の柔軟な枠組みと中国の管理型アプローチにも対応するには、地域ごとに異なるコンプライアンス体制の構築が必要です。このコスト負担は、資源に余裕のある大企業と中堅以下の企業との間に、セキュリティ格差を固定化する力学を生みかねません。

では、こうした制約のもとで、企業はどのような判断軸を持つことが有効なのでしょうか。

攻撃面を前提とした防御設計への転換

Ciscoの報告書が示唆するのは、AIセキュリティの焦点が「脆弱性の排除」から「攻撃面を前提とした防御設計」へと移行しつつあるという構造変化です。

200万以上のモデルと50万以上のデータセットが流通するエコシステムにおいて、すべてのコンポーネントの安全性を事前に保証することは現実的ではありません。代わりに、サプライチェーンの各段階で継続的に検証し、異常を検知する仕組みが求められています。Ciscoが公開したオープンソースのスキャナー群----pickleファザー、MCP・A2A・エージェントスキルファイルの検査ツール----は、この方向性を具体化した取り組みです。

エージェントAIについては、ゼロトラストの原則をAIエージェントにも適用する「AIゼロトラスト」の考え方が広がりつつあります。エージェントに付与する権限を最小化し、外部ツールとの連携時に都度検証を行い、自律的な判断の範囲に明確な境界を設ける----こうした設計思想は、2026年3月にCiscoが発表したAI Defenseの製品戦略にも反映されています。

組織的には、AIセキュリティをIT部門だけの課題として扱うのではなく、事業部門・法務・コンプライアンスを含む横断的なガバナンス体制の中に組み込む動きが加速する状況です。先進企業とその他の企業との間にある準備格差----セキュリティ統合率で33ポイント、エージェント制御体制で44ポイント----は、この組織設計の差を反映した数字といえるでしょう。

今後の展望

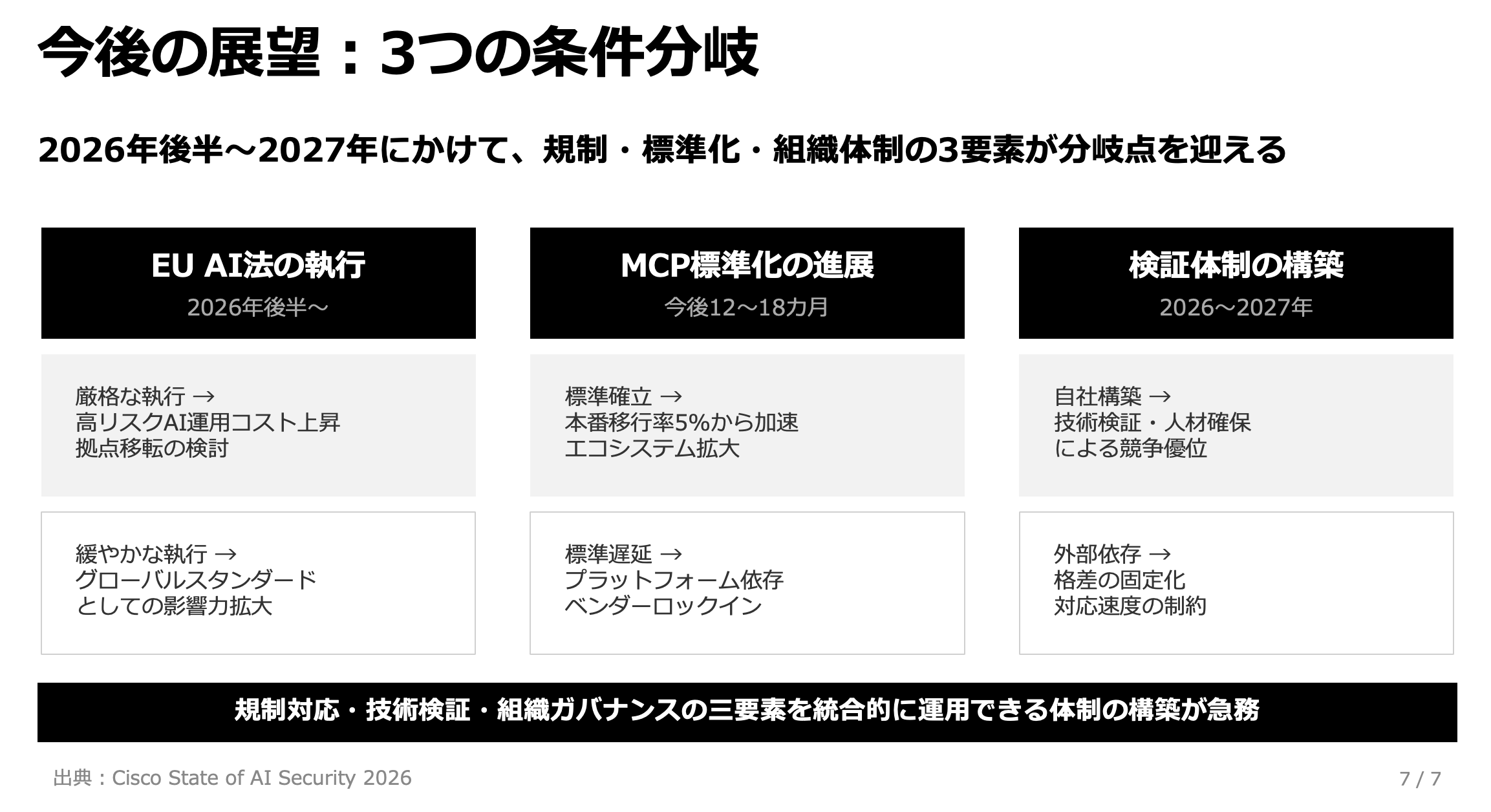

AIセキュリティの力学は、2026年後半から2027年にかけて、いくつかの条件分岐によって異なる方向に進む可能性があります。

EUのAI法が全面施行された2026年以降、実際の執行事例が蓄積されることで、規制の実効性が試されることになります。もし厳格な執行が行われれば、EU域内での高リスクAI運用コストが上昇し、一部の企業は規制の緩い地域へのAI開発拠点移転を検討するでしょう。逆に、執行が緩やかであれば、EUの規制枠組みがグローバルスタンダードとしての影響力を持つ展開も想定されます。

エージェントAIの本番環境への移行率は、今後12〜18カ月で急速に変動する見込みです。MCPを含むエージェント間通信プロトコルのセキュリティ標準が確立されれば、現在5%にとどまる本番移行率は加速するでしょう。標準化が遅れた場合、独自のセキュリティ基準を持つプラットフォーム事業者への依存度が高まり、ベンダーロックインのリスクが発生します。

AIサプライチェーンの検証体制を自社で構築できる組織と、外部の検証サービスに依存する組織との間の格差は拡大する方向にあります。Ciscoのような大手ベンダーがオープンソースツールを提供することで検証のハードルは下がりつつありますが、それらを運用に組み込むためには、AIセキュリティを理解する人材と、継続的なモニタリング体制の両方が必要です。

2026年後半から2027年にかけて優位に立つのは、規制対応・技術検証・組織ガバナンスの三要素を統合的に運用できる体制を、現時点から構築し始めている組織だと考えられます。準備格差が固定化する前の、この数四半期が実質的な判断の分かれ目となるでしょう。